Detta är en maskinöversättning av det engelska originaldokumentet. Vid eventuella avvikelser mellan denna översättning och den engelska originalversionen ska den engelska versionen ha företräde. Läs den engelska originalversionen

Ett Roblox-fusk, en månads tystnad och ett OAuth-intrång hos företag: vad Vercel-incidenten egentligen lär oss

2026-04-22 · Caiioo Team

Tre detaljer från Vercel-intrånget är värda att lyfta fram. Ingen av dem är huvudrubriken. Alla förändrar hur du bör tänka kring att installera AI-verktyg från tredje part.

Detalj 1: Försörjningskedjan till ett Vercel-intrång började med ett Roblox-fusk

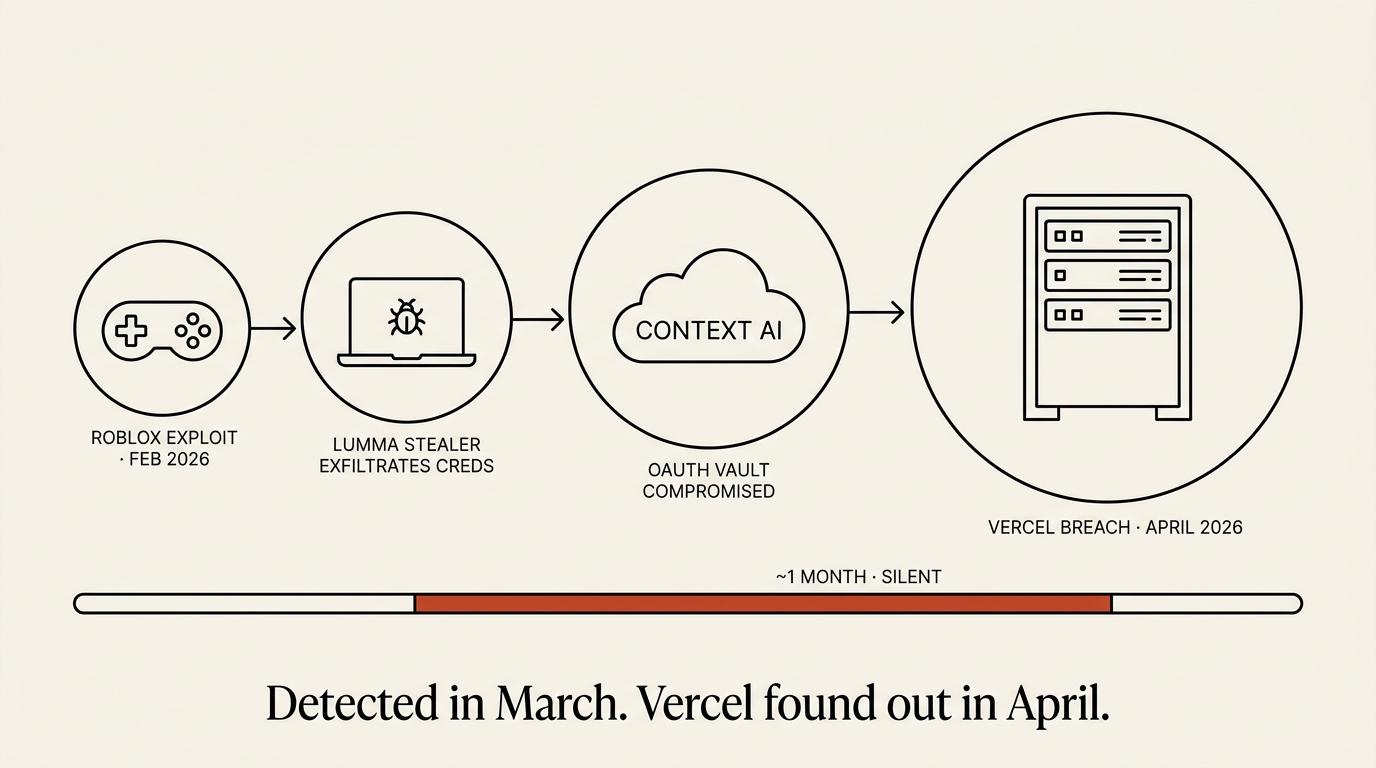

Den offentliga berättelsen om Vercel-incidenten går så här: en Vercel-anställd installerade Context AI, gav det breda Google Workspace-behörigheter, Context AI blev hackat, OAuth-tokenen kapades, angriparen tog sig vidare in i Vercel.

Det är berättelsen om vad som hände nedströms. Berättelsen uppströms är märkligare.

Enligt Hudson Rocks analys — som nu är samstämmig rapportering hos Trend Micro, OX Security, Strapi och The Hacker News, och som inte har motbevisats av varken Vercel eller Context AI per den 22 april — var den ursprungliga vektorn en Context AI-anställd vars personliga enhet komprometterades i februari 2026. Intrånget skedde via Lumma Stealer, en färdigköpt infostealer. Leveransmetoden var, enligt uppgift, en nedladdad Roblox "auto-farm"-spel-exploit.

Programvaran gjorde vad sådana gör. Den exfiltrerade den anställdes Google Workspace-inloggningsuppgifter och AWS-åtkomstuppgifter. Dessa uppgifter blev hävstången för allt nedströms: åtkomst till Context AIs AWS-miljö, åtkomst till OAuth-tokenvalvet som Context AI höll för sina konsumentanvändare, åtkomst till den token som en Vercel-anställd hade gett för sitt företags Google Workspace, och slutligen åtkomst till Vercels interna miljöer och en delmängd av kundernas miljövariabler.

Ett Roblox-fusk, på en anställds personliga bärbara dator, är grundorsaken till ett OAuth-intrång i försörjningskedjan som Vercel beskriver som något som potentiellt påverkar "hundratals användare i många organisationer".

Lärdomen är inte "Roblox är dåligt". Lärdomen är att i en SaaS-AI-arkitektur sträcker sig attackytan till varje anställds personliga enhet hos varje leverantör i din försörjningskedja. Du kan ha perfekt enhetshygien på ditt företag och ändå bli komprometterad för att någon två leverantörer bort laddade ner fel fil.

Detalj 2: Context AI visste i mars. De meddelade en kund.

Context AIs egen säkerhetsbulletin, publicerad på context.ai/security-update och uppdaterad den 21 april 2026, avslöjar denna tidslinje:

- Mars 2026: Context AI upptäcker obehörig åtkomst till AWS-miljön som är värd för deras utfasade produkt AI Office Suite. De anlitar CrowdStrike för forensik, fasar ut den påverkade miljön och meddelar en identifierad påverkad kund.

- Mellan mars och 19 april: OAuth-tokens som tillhör "vissa" av deras konsumentanvändare förblir komprometterade. Inga ytterligare användarmeddelanden skickas. Inget offentliggörande.

- 19 april 2026: Vercel publicerar sin bulletin om säkerhetsincidenten, efter att självständigt ha spårat intrånget tillbaka till Context AI genom sin egen forensik.

- 21 april 2026: Context AI uppdaterar sin bulletin med ytterligare vägledning till användare. Ingen fastställd tidsplan för att meddela de återstående påverkade konsumentanvändarna.

- 22 april 2026 (när detta skrivs): Fortfarande ingen tidsplan för meddelanden. De personer vars tokens komprometterades i februari vet fortfarande inte när, eller om, de kommer att få veta något.

Detta är den del som borde förändra hur tekniska team tänker kring att installera AI-verktyg från tredje part. Upptäckten av ett intrång hos leverantören är inte samma sak som att du får veta det.

Det finns i många fall ingen avtalsenlig eller regulatorisk skyldighet för leverantören att berätta för dig att deras tjänst komprometterats, även när intrånget inkluderade de OAuth-tokens du gav dem. Du kan göra allt rätt på din sida — minsta möjliga behörighet där det går, MFA, villkorad åtkomst, säkerhetsutbildning — och ändå agera utifrån angriparens tidsplan i månader, eftersom den enda part som kan varna dig är den part som inte vill säga något ännu.

Detalj 3: Context AI:s egen produktuppdelning bekräftar vilken arkitektur som överlever

Inbäddat i samma Context AI-bulletin finns en enda sats som väger tyngre än resten av dokumentet tillsammans.

Den produkt som utsattes för intrånget var AI Office Suite — Context AI:s utfasade konsumentprodukt. Deras nuvarande företagsprodukt, Bedrock, påverkades inte. Context AI:s egen angivna anledning: Bedrock "körs i kundmiljöer".

Samma företag, med samma ingenjörsteam, byggde två produkter med två olika arkitekturer. SaaS-mellanhanden — den som höll OAuth-tokens för kundens räkning i ett centraliserat moln — var den som dumpades. Den som körs i kundmiljön — den som placerade AI:n bredvid datan istället för datan bredvid AI:n — överlevde. Inte för att den hade bättre säkerhetsteknik, utan för att det inte fanns något centraliserat valv för angriparna att nå.

Du behöver inte ta caiioos ord för att centraliserad SaaS AI har ett strukturellt problem. Context AI:s egen produktlinje bekräftar det.

Vad detta innebär för alla som utvärderar AI-verktyg

Den samstämmiga strukturella lärdomen bland säkerhetsforskare — Trend Micro, Varonis, Halborn, OX Security, Strapi — är att breda "Tillåt alla"-OAuth-behörigheter är möjliggöraren. När de väl utfärdats kringgår dessa tokens MFA och villkorad åtkomst. Ett intrång hos leverantören blir ett intrång i varje konto nedströms.

Tre slutsatser följer:

- Föredra minsta möjliga behörighet där leverantören erbjuder det. Om ett AI-verktyg ber om läs- och skrivåtkomst till hela din Google Workspace för att utföra en kalenderfunktion, är begäran i sig en varningsflagga.

- Föredra leverantörer vars arkitektur inte kräver långlivade centraliserade tokens överhuvudtaget. Detta är det strukturella draget. Bring Your Own Auth (BYOA)-modeller, där OAuth-klienten tillhandahålls i ditt eget molnprojekt och tokens stannar på din enhet, tar bort leverantören helt från förtroendekedjan.

- Lita inte på leverantörens offentliggörande som ett tidigt varningssystem. Context AIs tidslinje — upptäckt i mars, meddelande till en kund, uppdatering av bulletin den 21 april utan åtagande om bredare användarmeddelande — är inte ett undantagsfall. Det är vad ekonomin kring offentliggörande av incidenter producerar i brist på strikta lagliga skyldigheter. Dina kontroller måste utgå från att leverantören inte kommer att berätta för dig i tid.

Hur Caiioo är byggt kring detta

Caiioo är en kraftfull, integritetsfokuserad arbetsyta med en agentisk koordinator och chattgränssnitt som körs i en sidopanel. Arkitekturen är byggd kring samma insikt som Context AI:s produktuppdelning oavsiktligt bekräftar: arbetsytan ska köras bredvid din data, inte hålla din data bredvid sig.

Den korta versionen: dina Workspace OAuth-tokens lagras krypterade på din enhet, inte i en caiioo-databas. Dina Gmail/Kalender/Drive API-anrop går från din enhet direkt till Google, utan att vår infrastruktur någonsin är i datavägen. Reläet vi driver — för samordning mellan enheter, OAuth-utbyten och licens-/faktureringstrafik — är byggt på Cloudflare Durable Objects per användare (varje användare är hårdvaruisolerad från alla andra användare) och använder änd-till-änd-kryptering på sin WebSocket-meddelandebuss (vi kan dirigera meddelanden men vi kan inte läsa dem). Vår centrala databas lagrar kontoidentitet, faktureringsstatus och routing-metadata — inte ditt innehåll, inte dina Workspace-tokens, inte dina konversationer. Den fullständiga tekniska genomgången, inklusive en trafiktabell du kan verifiera själv med Little Snitch eller Wireshark, finns i vårt kompletterande inlägg om det arkitektoniska svaret på detta intrång.

Det betyder att en incident i stil med Context AI mot Caiioo inte skulle kunna producera ett efterspel i stil med Context AI. Det skulle inte finnas något dumpat token-valv, eftersom det inte finns något token-valv. Det skulle inte finnas någon tyst månad där vi bestämmer när vi ska berätta för användarna, eftersom det inte skulle finnas något i vår infrastruktur för en angripare att ta från någon användare. Problemet med att leverantörsdetektering inte är ditt avslöjande försvinner när leverantören inte har något av ditt att hålla i från första början.

Prova Caiioo

Caiioo är tillgänglig som webbläsartillägg, infödd macOS-app, infödd iOS-app, infödd Android-app och skrivbordsapp för Windows och Linux. Kom igång gratis.

Källor:

- Vercel Knowledge Base: April 2026 security incident bulletin

- Context AI: Security update

- TechCrunch: App-värden Vercel säger att de hackats och kunddata stulits

- The Hacker News: Vercel-intrång kopplat till Context AI-hack

- Trend Micro: Vercel-intrånget — OAuth-attack mot leveranskedjan exponerar det dolda hotet

- OX Security: Vercel utsatt för intrång via Context AI-attack mot leveranskedjan

- Halborn: Förklarat — Vercel-hacket (april 2026)

- Varonis: Vercel-intrånget — Stegen att ta nu

- Strapi: Vercel-säkerhetsintrång april 2026

- SANS Institute NewsBites Volym XXVIII Utgåva 30, 21 april 2026