Questa è una traduzione automatica del documento originale in inglese. In caso di discrepanze tra la presente traduzione e la versione originale in inglese, prevarrà la versione inglese. Leggi la versione originale in inglese

Un trucco per Roblox, un mese di silenzio e una violazione OAuth aziendale: cosa sta insegnando davvero l'incidente di Vercel

2026-04-22 · Caiioo Team

Tre dettagli della violazione di Vercel meritano di essere messi in evidenza. Nessuno di questi è il titolo principale. Tutti cambiano il modo in cui dovresti considerare l'installazione di strumenti di IA di terze parti.

Dettaglio 1: La catena di approvvigionamento della violazione di Vercel è iniziata con un trucco per Roblox

La narrazione pubblica dell'incidente di Vercel è questa: un dipendente di Vercel ha installato Context AI, gli ha concesso ampi permessi per Google Workspace, Context AI è stata violata, il token OAuth è stato rubato e l'attaccante è penetrato in Vercel.

Questa è la storia a valle. La storia a monte è più strana.

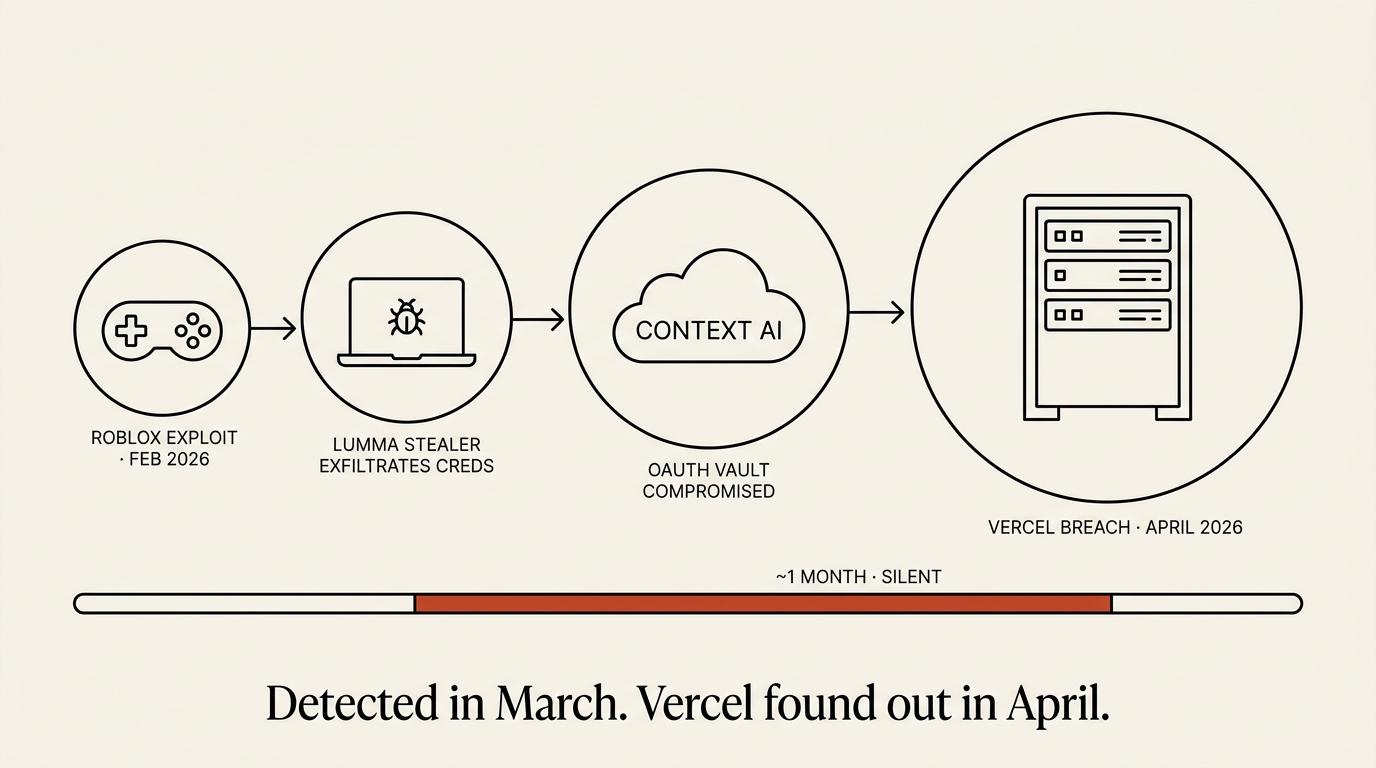

Secondo l'analisi di Hudson Rock — ora confermata da Trend Micro, OX Security, Strapi e The Hacker News, e non smentita né da Vercel né da Context AI al 22 aprile — il vettore originale è stato un dipendente di Context AI il cui dispositivo personale è stato compromesso nel febbraio 2026. La compromissione è avvenuta tramite Lumma Stealer, un infostealer comune. Il veicolo di diffusione, a quanto riferito, è stato un exploit scaricato per il gioco Roblox denominato "auto-farm".

Lo stealer ha fatto il suo lavoro: ha sottratto le credenziali Google Workspace e le credenziali di accesso AWS del dipendente. Quelle credenziali sono diventate il punto di leva per tutto ciò che è seguito: accesso all'ambiente AWS di Context AI, accesso al deposito dei token OAuth che Context AI conservava per conto dei suoi utenti, accesso al token che un dipendente di Vercel aveva concesso per il proprio Google Workspace aziendale e, infine, accesso agli ambienti interni di Vercel e a un sottoinsieme di variabili d'ambiente dei clienti.

Un trucco per Roblox, sul laptop personale di un dipendente, è la causa principale di una violazione della supply chain OAuth aziendale che Vercel descrive come potenzialmente impattante per "centinaia di utenti in molte organizzazioni".

La lezione non è "Roblox è cattivo". La lezione è che in un'architettura SaaS-AI, la superficie di attacco si estende a ogni dispositivo personale di ogni dipendente di ogni fornitore nella tua catena di approvvigionamento. Puoi avere un'igiene degli endpoint perfetta nella tua azienda e risultare comunque compromesso perché qualcuno a due fornitori di distanza ha scaricato il file sbagliato.

Dettaglio 2: Context AI sapeva a marzo. Hanno informato un solo cliente.

Il bollettino di sicurezza di Context AI, pubblicato su context.ai/security-update e aggiornato il 21 aprile 2026, rivela questa cronologia:

- Marzo 2026: Context AI rileva un accesso non autorizzato all'ambiente AWS che ospita il loro prodotto deprecato AI Office Suite. Incaricano CrowdStrike per l'analisi forense, deprecano l'ambiente interessato e informano un unico cliente identificato come colpito.

- Tra marzo e il 19 aprile: I token OAuth appartenenti ad "alcuni" dei loro utenti consumer rimangono compromessi. Non vengono effettuate ulteriori notifiche agli utenti. Nessuna divulgazione pubblica.

- 19 aprile 2026: Vercel pubblica il suo bollettino sull'incidente di sicurezza, avendo rintracciato indipendentemente la compromissione fino a Context AI tramite la propria analisi forense.

- 21 aprile 2026: Context AI aggiorna il suo bollettino con ulteriori linee guida per gli utenti. Nessuna tempistica certa per informare i restanti utenti consumer colpiti.

- 22 aprile 2026 (al momento della scrittura): Ancora nessuna tempistica di notifica. Le persone i cui token sono stati compromessi a febbraio non sanno ancora quando, o se, verranno informate.

Questa è la parte che dovrebbe cambiare il modo in cui i team tecnici pensano all'installazione di strumenti di IA di terze parti. Il rilevamento di una violazione presso il fornitore non coincide con la comunicazione a te.

In molti casi, non esiste alcun obbligo contrattuale o normativo che imponga al fornitore di dirti che il suo servizio è stato compromesso, anche quando la violazione include i token OAuth che gli hai consegnato. Puoi fare tutto bene dalla tua parte — permessi minimi dove possibile, MFA, accesso condizionale, formazione sulla sicurezza — e trovarti comunque in balia dell'attaccante per mesi, perché l'unica parte in grado di avvisarti è quella che non vuole ancora dire nulla.

Dettaglio 3: La divisione dei prodotti di Context AI conferma quale architettura sopravvive

Sepolta nello stesso bollettino di Context AI c'è una singola clausola che ha più peso di tutto il resto del documento messo insieme.

Il prodotto violato era la AI Office Suite — il prodotto consumer deprecato di Context AI. Il loro attuale prodotto aziendale, Bedrock, non è stato colpito. La ragione dichiarata da Context AI: Bedrock "viene eseguito negli ambienti dei clienti".

La stessa azienda, con lo stesso team di ingegneri, ha costruito due prodotti con due architetture diverse. Quello basato su SaaS-intermediario — quello che conservava i token OAuth per conto del cliente in un cloud centralizzato — è stato quello violato. Quello che viene eseguito nell'ambiente del cliente — quello che ha messo l'IA accanto ai dati invece dei dati accanto all'IA — è sopravvissuto. Non perché avesse una migliore ingegneria della sicurezza, ma perché non c'era un caveau centralizzato raggiungibile dagli aggressori.

Non devi credere sulla parola a Caiioo che l'IA SaaS centralizzata abbia un problema strutturale. La linea di prodotti di Context AI stessa lo conferma.

Cosa significa per chiunque valuti strumenti di IA

La lezione strutturale condivisa dalla comunità di ricerca sulla sicurezza — Trend Micro, Varonis, Halborn, OX Security, Strapi — è che gli ampi permessi OAuth "Consenti tutto" sono il fattore abilitante. Una volta emessi, questi token eludono MFA e accesso condizionale. Una compromissione presso il fornitore diventa una compromissione di ogni account a valle.

Seguono tre conclusioni:

- Prediligi permessi minimi necessari dove il fornitore li offre. Se uno strumento di IA chiede l'accesso in lettura-scrittura a tutto il tuo Google Workspace per una funzione di calendario, la richiesta è un segnale d'allarme.

- Prediligi fornitori la cui architettura non richiede affatto token centralizzati a lunga durata. Questa è la mossa strutturale. I modelli Bring Your Own Auth (BYOA), in cui il client OAuth è configurato nel tuo progetto cloud e i token rimangono sul tuo dispositivo, rimuovono completamente il fornitore dalla catena di fiducia.

- Non fare affidamento sulla divulgazione del fornitore come sistema di allerta precoce. La cronologia di Context AI — rilevamento a marzo, notifica a un solo cliente, aggiornamento del bollettino il 21 aprile senza ancora un impegno per una notifica più ampia — non è un'eccezione. È ciò che produce l'economia della divulgazione degli incidenti in assenza di rigidi obblighi legali. I tuoi controlli devono presupporre che il fornitore non ti avviserà in tempo.

Come Caiioo è costruito attorno a questo

Caiioo è uno spazio di lavoro potente e orientato alla privacy con un orchestratore di agenti e un'interfaccia chat che viene eseguita in un pannello laterale. L'architettura è costruita attorno alla stessa intuizione che la divisione dei prodotti di Context AI conferma accidentalmente: lo spazio di lavoro dovrebbe essere eseguito accanto ai tuoi dati, non conservare i tuoi dati accanto a sé.

In breve: i tuoi token OAuth di Workspace sono memorizzati crittografati sul tuo dispositivo, non in un database caiioo. Le tue chiamate API Gmail/Calendar/Drive vanno dal tuo dispositivo direttamente a Google, senza che la nostra infrastruttura sia mai nel percorso dei dati. Il relay che gestiamo — per il coordinamento tra dispositivi, gli scambi OAuth e il traffico di licenze/fatturazione — è costruito su Cloudflare Durable Objects per utente (ogni utente è isolato a livello hardware da ogni altro) e utilizza la crittografia end-to-end sul suo bus di messaggi WebSocket (possiamo instradare i messaggi ma non possiamo leggerli). Il nostro database centrale memorizza l'identità dell'account, lo stato di fatturazione e i metadati di instradamento — non i tuoi contenuti, non i tuoi token di Workspace, non le tue conversazioni. L'analisi tecnica completa, inclusa una tabella del traffico che puoi verificare tu stesso con Little Snitch o Wireshark, si trova nel nostro post di approfondimento sulla risposta architettonica a questa violazione.

Ciò significa che un incidente in stile Context AI contro Caiioo non potrebbe produrre conseguenze in stile Context AI. Non ci sarebbe alcun caveau di token rubato, perché non esiste alcun caveau di token. Non ci sarebbe un mese di silenzio mentre decidiamo quando informare gli utenti, perché non ci sarebbe nulla nella nostra infrastruttura che un aggressore possa sottrarre a qualsiasi utente. Il problema del "rilevamento del fornitore non è la tua divulgazione" scompare quando il fornitore non ha nulla di tuo da conservare in primo luogo.

Prova Caiioo

Caiioo è disponibile come estensione del browser, app nativa per macOS, app nativa per iOS, app nativa per Android e app desktop per Windows e Linux. Inizia gratuitamente.

Fonti:

- Vercel Knowledge Base: Bollettino incidente di sicurezza aprile 2026

- Context AI: Aggiornamento sulla sicurezza

- TechCrunch: L'host di app Vercel afferma di essere stato hackerato e che i dati dei clienti sono stati rubati

- The Hacker News: Violazione di Vercel legata all'hack di Context AI

- Trend Micro: La violazione di Vercel — L'attacco alla catena di approvvigionamento OAuth espone la minaccia nascosta

- OX Security: Vercel violata tramite attacco alla catena di approvvigionamento di Context AI

- Halborn: Spiegazione — L'hack di Vercel (aprile 2026)

- Varonis: La violazione di Vercel — I passi da compiere ora

- Strapi: Violazione della sicurezza di Vercel aprile 2026

- SANS Institute NewsBites Volume XXVIII Issue 30, 21 aprile 2026