Esta é uma tradução automática do documento original em inglês. Em caso de conflito entre esta tradução e a versão original em inglês, a versão em inglês prevalecerá. Ler a versão original em inglês

Um cheat de Roblox, um mês de silêncio e uma violação de OAuth empresarial: o que o incidente da Vercel realmente está ensinando

2026-04-22 · Caiioo Team

Três detalhes da violação da Vercel valem a pena ser destacados. Nenhum deles é a manchete principal. Todos eles mudam a forma como você deve pensar sobre a instalação de ferramentas de IA de terceiros.

Detalhe 1: A cadeia de suprimentos para a violação da Vercel começou com um cheat de Roblox

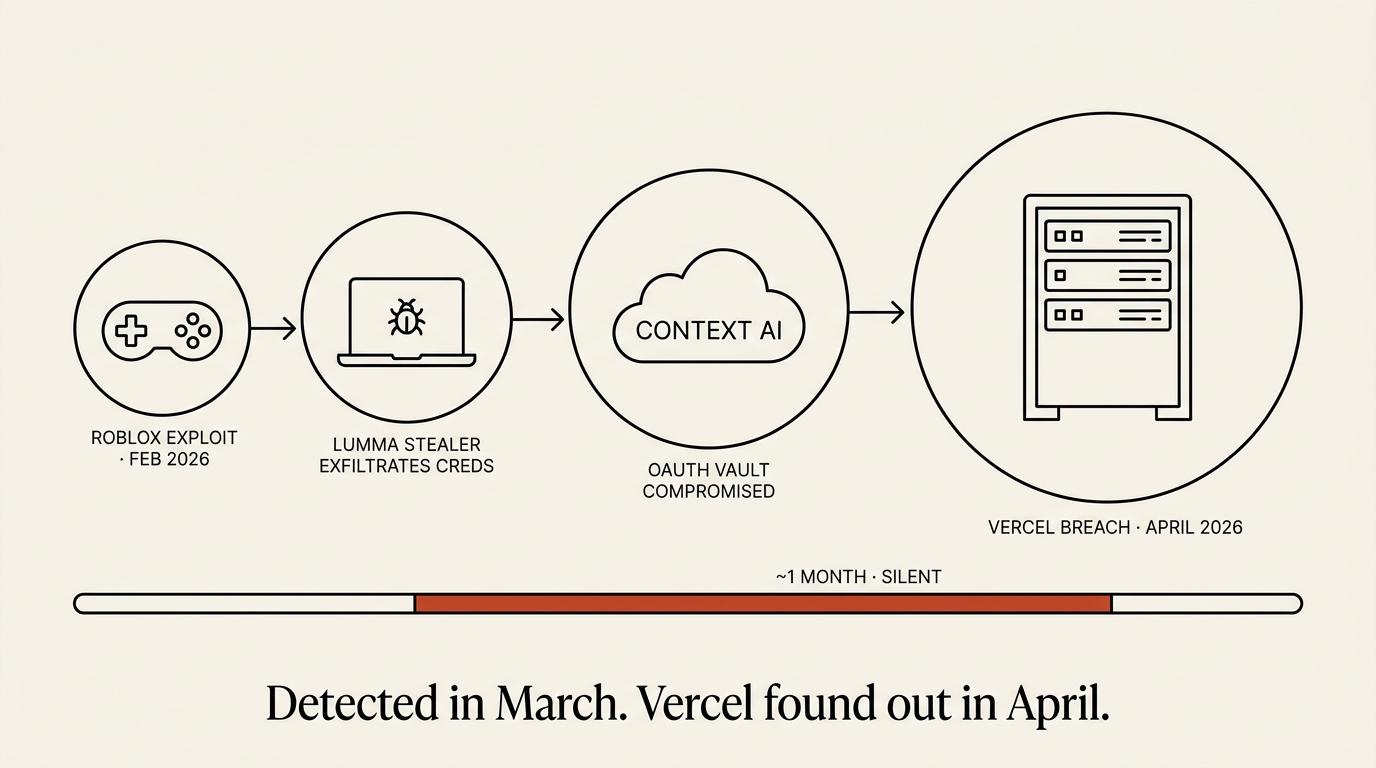

A narrativa pública do incidente da Vercel é a seguinte: um funcionário da Vercel instalou a Context AI, concedeu a ela escopos amplos do Google Workspace, a Context AI foi violada, o token OAuth foi sequestrado, o invasor entrou na Vercel.

Essa é a história a jusante. A história a montante é mais estranha.

De acordo com a análise da Hudson Rock — agora um consenso em reportagens da Trend Micro, OX Security, Strapi e The Hacker News, e não refutada pela Vercel nem pela Context AI até 22 de abril — o vetor original foi um funcionário da Context AI cujo dispositivo pessoal foi comprometido em fevereiro de 2026. O comprometimento foi o Lumma Stealer, um infostealer comum. O veículo de entrega, supostamente, foi um exploit de jogo "auto-farm" de Roblox baixado.

O stealer fez o que os stealers fazem. Exfiltrou as credenciais do Google Workspace e as credenciais de acesso à AWS do funcionário. Essas credenciais tornaram-se o ponto de alavancagem para tudo o que veio depois: acesso ao ambiente AWS da Context AI, acesso ao cofre de tokens OAuth que a Context AI mantinha em nome de seus usuários consumidores, acesso ao token que um funcionário da Vercel concedeu para seu Google Workspace corporativo e, por fim, acesso aos ambientes internos da Vercel e a um subconjunto de variáveis de ambiente de clientes.

Um cheat de Roblox, no laptop pessoal de um funcionário, é a causa raiz de uma violação da cadeia de suprimentos OAuth empresarial que a Vercel descreve como afetando potencialmente "centenas de usuários em muitas organizações".

A lição não é "Roblox é ruim". A lição é que, em uma arquitetura SaaS-AI, a superfície de ataque se estende a cada dispositivo pessoal de cada funcionário em cada fornecedor da sua cadeia de suprimentos. Você pode ter uma higiene de endpoint perfeita em sua empresa e ainda assim ser comprometido porque alguém a dois fornecedores de distância baixou o arquivo errado.

Detalhe 2: A Context AI sabia em março. Eles notificaram um cliente.

O próprio boletim de segurança da Context AI, publicado em context.ai/security-update e atualizado em 21 de abril de 2026, divulga este cronograma:

- Março de 2026: A Context AI detecta acesso não autorizado ao ambiente AWS que hospeda seu produto AI Office Suite descontinuado. Eles contratam a CrowdStrike para perícia, descontinuam o ambiente afetado e notificam um cliente identificado como impactado.

- Entre março e 19 de abril: Tokens OAuth pertencentes a "alguns" de seus usuários consumidores permanecem comprometidos. Nenhuma outra notificação de usuário é feita. Nenhuma divulgação pública.

- 19 de abril de 2026: A Vercel publica seu boletim de incidente de segurança, tendo rastreado independentemente o comprometimento até a Context AI por meio de sua própria perícia.

- 21 de abril de 2026: A Context AI atualiza seu boletim com orientações adicionais para o usuário. Nenhum cronograma comprometido para notificar os demais usuários consumidores impactados.

- 22 de abril de 2026 (até o momento): Ainda sem cronograma de notificação. As pessoas cujos tokens foram comprometidos em fevereiro ainda não sabem quando, ou se, serão informadas.

Esta é a parte que deve mudar a forma como as equipes técnicas pensam sobre a instalação de ferramentas de IA de terceiros. A detecção de violação no fornecedor não é o mesmo que a divulgação para você.

Não há, em muitos casos, obrigação contratual ou regulatória para o fornecedor informar que seu serviço foi comprometido, mesmo quando o comprometimento incluiu os tokens OAuth que você entregou a eles. Você pode fazer tudo certo do seu lado — escopos de menor privilégio sempre que possível, MFA, acesso condicional, treinamento de conscientização de segurança — e ainda assim estar operando no relógio do invasor por meses, porque a única parte posicionada para avisá-lo é a parte que ainda não quer dizer nada.

Detalhe 3: A própria divisão de produtos da Context AI confirma qual arquitetura sobrevive

Enterrada no mesmo boletim da Context AI está uma única cláusula que carrega mais peso do que o resto do documento combinado.

O produto violado foi o AI Office Suite — o produto de consumo descontinuado da Context AI. O produto empresarial atual deles, Bedrock, não foi afetado. O motivo declarado pela própria Context AI: o Bedrock "roda nos ambientes dos clientes".

A mesma empresa, com a mesma equipe de engenharia, construiu dois produtos com duas arquiteturas diferentes. O intermediário SaaS — aquele que mantinha tokens OAuth em nome do cliente em uma nuvem centralizada — foi o que foi exposto. O que roda no ambiente do cliente — aquele que colocou a IA próxima aos dados em vez dos dados próximos à IA — sobreviveu. Não porque tivesse uma melhor engenharia de segurança, mas porque não havia um cofre centralizado para os atacantes alcançarem.

Você não precisa acreditar na palavra do Caiioo de que a IA SaaS centralizada tem um problema estrutural. A própria linha de produtos da Context AI confirma isso.

O que isso significa para quem avalia ferramentas de IA

A lição estrutural consensual em toda a comunidade de pesquisa de segurança — Trend Micro, Varonis, Halborn, OX Security, Strapi — é que escopos OAuth amplos de "Permitir Tudo" são os facilitadores. Uma vez emitidos, esses tokens burlam MFA e acesso condicional. Um comprometimento no fornecedor torna-se um comprometimento de cada conta a jusante.

Seguem três conclusões:

- Prefira escopos de menor privilégio onde o fornecedor os oferecer. Se uma ferramenta de IA pedir acesso de leitura e gravação a todo o seu Google Workspace para uma função de Calendário, o pedido é um sinal de alerta.

- Prefira fornecedores cuja arquitetura não exija tokens centralizados de longa duração. Esta é a mudança estrutural. Modelos Bring Your Own Auth (BYOA), onde o cliente OAuth é provisionado em seu próprio projeto de nuvem e os tokens permanecem em seu dispositivo, removem totalmente o fornecedor da cadeia de confiança.

- Não confie na divulgação do fornecedor como um sistema de alerta precoce. O cronograma da Context AI — detecção em março, notificação de um cliente, atualização do boletim em 21 de abril ainda sem compromisso com a notificação mais ampla do usuário — não é uma exceção. É o que a economia da divulgação de incidentes produz na ausência de obrigações legais estritas. Seus controles devem assumir que o fornecedor não o avisará a tempo.

Como o Caiioo é construído em torno disso

O Caiioo é um espaço de trabalho poderoso e focado em privacidade, com um orquestrador de agentes e interface de chat que roda em um painel lateral. A arquitetura é construída em torno da mesma percepção que a divisão de produtos da Context AI confirmou acidentalmente: o espaço de trabalho deve rodar ao lado dos seus dados, não manter seus dados ao lado dele.

A versão curta: seus tokens OAuth do Workspace são armazenados criptografados no seu dispositivo, não em um banco de dados do caiioo. Suas chamadas de API do Gmail/Agenda/Drive vão do seu dispositivo diretamente para o Google, com nossa infraestrutura nunca estando no caminho dos dados. O relé que operamos — para coordenação entre dispositivos, trocas OAuth e tráfego de licença/faturamento — é construído em Cloudflare Durable Objects por usuário (cada usuário é isolado por hardware de todos os outros usuários) e usa criptografia de ponta a ponta em seu barramento de mensagens WebSocket (podemos rotear mensagens, mas não podemos lê-las). Nosso banco de dados central armazena identidade da conta, estado de faturamento e metadados de roteamento — não seu conteúdo, não seus tokens do Workspace, não suas conversas. O detalhamento técnico completo, incluindo uma tabela de tráfego que você mesmo pode verificar com Little Snitch ou Wireshark, vive em nosso post complementar sobre a resposta arquitetônica a esta violação.

Isso significa que um incidente no estilo Context AI contra o Caiioo não poderia produzir um resultado no estilo Context AI. Não haveria um cofre de tokens exposto, porque não existe um cofre de tokens. Não haveria um mês de silêncio nosso decidindo quando contar aos usuários, porque não haveria nada em nossa infraestrutura para um invasor tirar de qualquer usuário. O problema de "detecção do fornecedor não é sua divulgação" desaparece quando o fornecedor não tem nada seu para guardar, para começar.

Experimente o Caiioo

O Caiioo está disponível como extensão de navegador, app nativo para macOS, app nativo para iOS, app nativo para Android e app de desktop para Windows e Linux. Comece GRATIS.

Fontes:

- Vercel Knowledge Base: Boletim de incidente de segurança de abril de 2026

- Context AI: Atualização de segurança

- TechCrunch: Hospedagem de apps Vercel diz que foi hackeada e dados de clientes roubados

- The Hacker News: Violação da Vercel ligada ao hack da Context AI

- Trend Micro: A violação da Vercel — Ataque à cadeia de suprimentos OAuth expõe a ameaça oculta

- OX Security: Vercel violada via ataque à cadeia de suprimentos da Context AI

- Halborn: Explicado — O hack da Vercel (abril de 2026)

- Varonis: A violação da Vercel — Os passos a tomar agora

- Strapi: Violação de segurança da Vercel em abril de 2026

- SANS Institute NewsBites Volume XXVIII Edição 30, 21 de abril de 2026