यह मूल अंग्रेजी दस्तावेज़ का मशीन अनुवाद है। इस अनुवाद और मूल अंग्रेजी संस्करण के बीच किसी भी विवाद की स्थिति में, अंग्रेजी संस्करण ही मान्य होगा। मूल अंग्रेजी संस्करण पढ़ें

AI प्रदाता और API कुंजियाँ

Caiioo विभिन्न प्रदाताओं के 500+ AI मॉडल से जुड़ता है। आप अपनी खुद की API कुंजियाँ लाते हैं—इसका मतलब है कि आप सीधे प्रदाताओं को भुगतान करते हैं, और Caiioo आपके खर्च को कभी नहीं छूता है।

समर्थित प्रदाता: OpenRouter (डिफ़ॉल्ट), Anthropic, Google Gemini, OpenAI, Poe, Ollama, और MLX (Apple Silicon)। आप OpenRouter के माध्यम से सैकड़ों अतिरिक्त मॉडल (Mistral, Groq, Llama, और अधिक) तक भी पहुँच सकते हैं। नीतियों के लिए उपयोग की शर्तें देखें।

शुरू करें (दो विकल्प)

विकल्प 1: मुफ़्त प्रदान की गई कुंजी का उपयोग करें

हम एक मुफ़्त API कुंजी प्रदान करते हैं जो आपको तुरंत Caiioo आज़माने देती है। इसमें उपयोग की सीमाओं के साथ चुनिंदा मुफ़्त मॉडल तक पहुँच है—चीजों के परीक्षण के लिए एकदम सही।

इसका उपयोग जारी रखने के लिए: बस Caiioo खोलें और चैटिंग शुरू करें। किसी सेटअप की आवश्यकता नहीं है।

विकल्प 2: अपनी खुद की कुंजी लाएं (BYOK)

चुनने के लिए 500+ मॉडल चाहते हैं? अपनी खुद की API कुंजी जोड़ें।

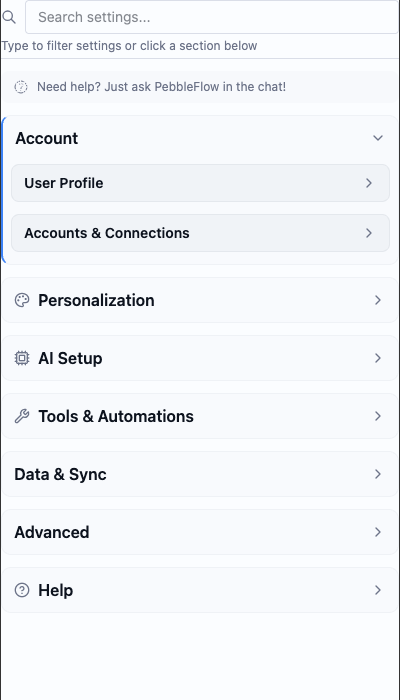

- सेटिंग्स > AI प्रदाता पर जाएं

- अपना प्रदाता चुनें (OpenRouter, Anthropic, Google, OpenAI, Poe, Ollama, या MLX)

- अपनी API कुंजी पेस्ट करें (या स्थानीय मॉडल के लिए अपना Ollama सर्वर URL सेट करें)

- बस इतना ही—कुंजियाँ आपके डिवाइस पर रहती हैं और आपकी मशीन से कभी बाहर नहीं जाती हैं

त्वरित कार्य मॉडल

त्वरित कार्य (जैसे सारांशित करना, अनुवाद करना, या समझाना) आपके डिफ़ॉल्ट मॉडल से भिन्न मॉडल का उपयोग कर सकते हैं। इसे सेट करने के लिए, हेडर में मॉडल पिकर ड्रॉपडाउन खोलें और वहां से एक त्वरित कार्य मॉडल चुनें। यदि सेट नहीं है, तो त्वरित कार्य आपके डिफ़ॉल्ट मॉडल का उपयोग करते हैं।

API कुंजियाँ कहाँ से प्राप्त करें

| प्रदाता | इसे क्यों चुनें | कुंजी यहाँ प्राप्त करें |

|---|---|---|

| OpenRouter (डिफ़ॉल्ट) | एक ही स्थान पर 500+ मॉडल (Claude, GPT, Gemini, Llama, और बहुत कुछ) | openrouter.ai |

| Gemini मॉडल तक सीधी पहुँच | ai.google.dev | |

| Anthropic | Claude मॉडल तक सीधी पहुँच | console.anthropic.com |

| OpenAI | GPT और DALL-E मॉडल तक सीधी पहुँच | platform.openai.com |

| Poe | Poe के API के माध्यम से कई AI मॉडल तक पहुँच | poe.com |

| Ollama | अपनी मशीन पर स्थानीय रूप से ओपन-सोर्स मॉडल चलाएं — पूरी तरह से निजी | ollama.com |

| MLX (Apple Silicon) | MLX के माध्यम से Mac पर स्थानीय रूप से मॉडल चलाएं, पूरी तरह से निजी | किसी कुंजी की आवश्यकता नहीं — स्थानीय रूप से MLX मॉडल इंस्टॉल करें |

OpenRouter डिफ़ॉल्ट विकल्प है—Caiioo के टूल OpenRouter की मॉडल रजिस्ट्री की अपेक्षा करते हैं, और एक एकल OpenRouter कुंजी पूरे कैटलॉग को अनलॉक कर देती है। प्रत्यक्ष प्रदाता कुंजियाँ (Anthropic, Google, OpenAI) और स्थानीय विकल्प (Ollama, MLX) विकल्प के रूप में काम करते हैं जब आप प्रदाता-विशिष्ट सुविधाएँ या पूरी तरह से ऑफ़लाइन अनुमान चाहते हैं।

API कुंजी सुरक्षा

आपकी API कुंजियाँ आपके डिवाइस पर स्थानीय रूप से संग्रहीत होती हैं। वे कभी भी Caiioo सर्वर पर नहीं भेजी जाती हैं। जब आप कोई अनुरोध करते हैं, तो आपकी कुंजी सीधे AI प्रदाता के पास जाती है। पूरी कहानी के लिए गोपनीयता और डेटा देखें।

प्रदर्शन आपके मॉडल पर निर्भर करता है

Caiioo ऑर्केस्ट्रेशन — टूल, संदर्भ, मल्टी-स्टेप वर्कफ़्लो को संभालता है। लेकिन AI की प्रतिक्रियाओं की गुणवत्ता इस बात पर निर्भर करती है कि आप कौन सा मॉडल चुनते हैं।

जटिल कार्यों के लिए (शोध, विश्लेषण, लंबे दस्तावेज़): Claude Opus/Sonnet, GPT-4.1, या Gemini 2.5 Pro जैसे फ्रंटियर मॉडल का उपयोग करें। वे मल्टी-स्टेप रीजनिंग और टूल के उपयोग को सबसे अच्छी तरह संभालते हैं।

त्वरित उत्तरों के लिए (प्रश्न, सारांश, सरल संपादन): Claude Haiku, GPT-4.1 mini, या Gemini 2.5 Flash जैसे तेज़ मॉडल सस्ते और तेज़ हैं। रोज़मर्रा के कार्यों के लिए एकदम सही।

प्रयोग करने के लिए: OpenRouter आपको एक API कुंजी के साथ 500+ मॉडल आज़माने देता है। पता लगाएं कि आपके वर्कफ़्लो के लिए सबसे अच्छा क्या काम करता है।

Caiioo के टूल, संदर्भ परतें और ऑर्केस्ट्रेशन आपके द्वारा चुने गए किसी भी मॉडल को बेहतर बनाते हैं। एक अच्छा मॉडल तब महान बन जाता है जब उसके पास काम करने के लिए सही संदर्भ और टूल होते हैं।

यह भी देखें

- सदस्यता और बिलिंग — FREE, Pro, और प्लेटफॉर्म टियर सुविधाएं

- गोपनीयता और डेटा — कीज़ को कैसे स्टोर और हैंडल किया जाता है

This guide is maintained by the Caiioo team using Slate, our built-in editor.